Первый взгляд на LaTeX

Аллюзия на документацию по LaTeX

Для личных нужд решил изучить эту штуку. Пока просмотрел только документацию, но определённое мнение сформировалось. Сейчас поделюсь.

Для затравки вот цитата из исследования эффективности MS Word & LaTeX.

We show that LaTeX users were slower than Word users, wrote less text in the same amount of time, and produced more typesetting, orthographical, grammatical, and formatting errors. On most measures, expert LaTeX users performed even worse than novice Word users. LaTeX users, however, more often report enjoying using their respective software.

An Efficiency Comparison of Document Preparation Systems Used in Academic Research and Development Markus Knauff*, Jelica Nejasmic.

Генерация текста на русском по шаблонам

И пять лет не прошло (на самом деле прошло), как у меня дошли руки рассказать чем генерируются тексты в Сказке (хабр).

Стастья о python библиотеке для генерации текстов с учётом зависимости слов и их грамматических особенностей.

Github: https://github.com/the-tale/utg PyPi: https://pypi.org/project/UTG/

О проектировании миров

](https://tiendil.org/static/posts/about-worlds-building/images/rashap-2.gif)

Таким может быть ваш новый мир (c) Рашап

Этот пост я начал писать как часть рецензии на произведения Сюзанны Кларк, но быстро понял что ухожу в сторону от основной темы. Поэтому в рецензии оставил только то, что напрямую касается мира английской магии, а тему проектирования миров подробнее раскрыл тут.

Изначально эссе было опубликовано на DTF, но я решил вернуть его в блог. Изменений не делал, поэтому подача может немного отличаться от обычной для блога.

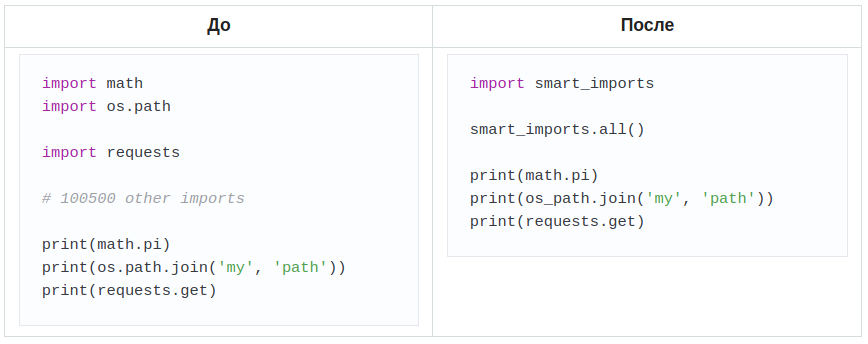

Автоматизация импортов в Python

Пример автоматизаиции импорта.

Написал библиотеку для автоматического импорта модулей в Python. Анализирует код и самостоятельно импортирует что надо. Называется smart imports: pypi, github.

Написал год назад (то есть год уже использую в своих проектах), но написать статью только сейчас руки дошли :-)

Документация пока находится на хабре.

Нейронный сети научили генерировать полноценные анимэшные аватарки

Пример сгенерированных нейронной сетью аватарок

Пример можно найти на картинке и по ссылкам:

Но куда интереснее не сам результат, а способ его получения:

- Сырую обучающую выборку слили с сайта об японских играх (изображения персонажей).

- На этих изображениях сторонней нейронной сетью распознали лица.

- Другой сторонней нейронной сетью назначили полученным портретам теги (цвет волос, глаз, etc).

- Обучили свою сеть, которая по параметрам генерирует картинки.

- Использовали сеть из пункта 3 для расчёта оценочной функции (на сколько полученная картинка соответствует требованиям).

- Конечный результат получается генерацией нескольких аватарок и выбором одной с лучшим значением оценочной функции.

То есть в работе задействовано 3 нейронные сети, 2 из которых — обучены ранее другими людьми. По этому поводу можно было бы расписать много интересного, но просто оставлю как факт.