Мигрируем с GPT-3.5-turbo на GPT-4o-mini

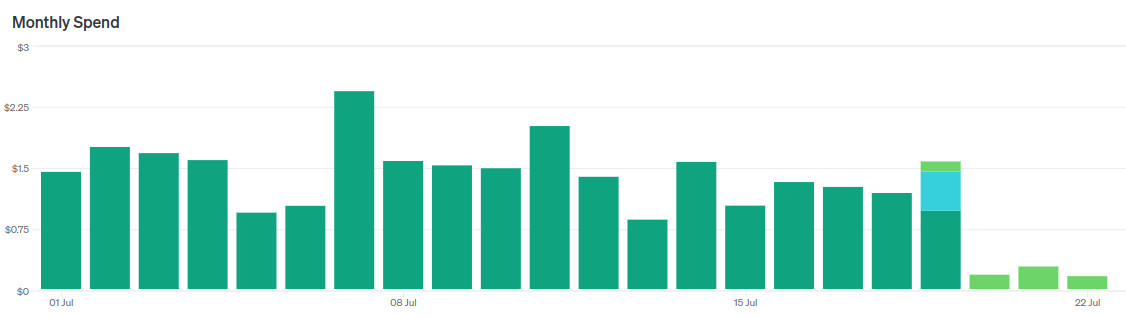

Угадайте когда я переключил модели.

На днях OpenAI выпустила GPT-4o-mini — новую флагманскую модель для дешёвого сегмента, так сказать.

- Говорят, работает «почти как» GPT-4o, а иногда даже круче GPT-4.

- Почти в 3 раза дешевле GPT-3.5-turbo.

- Размер контекста 128k токенов, против 16k у GPT-3.5-turbo.

Конечно я сразу побежал переводить на эту модель свою читалку новостей.

Если кратко подвести итоги, то это крутая замена GPT-3.5-turbo. У меня получилось сходу, не меняя промпты, заменить двух LLM агентов на одного и суммарно удешевить работу читалки раз в 5 без потери качества.

Но потом я полез тюнить промпт, чтобы сделать ещё круче, и начал сталкиваться с нюансами. О них расскажу далее.

Используем DALL-E-3 для геймдева

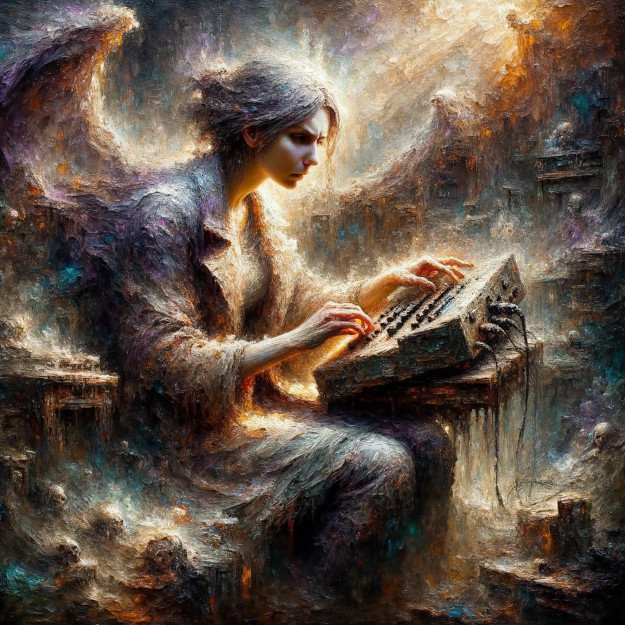

DALL-E: "Draw a Vrubel-style painting of an indie game developer working on her game, like The Demon Seated. With the accent on Vrubel style."

Получил доступ к DALL-E-3, а значит можно повторить прошлогодний эксперимент и посмотреть что изменилось.

Фантазировать, искать новые направления пока не буду, повторим идеи и запросы из прошлогоднего поста.

Осторожно, много трафика — DALL-E отдаёт png файлы размером 1-2 мегабайта. Я их немного пожал, но пост всё равно будет тяжёлым.

OpenAI Chat для геймдева

Vrubel-style painting of how a game designer work on game texts (c) DALL-E

Раз поигрался с DALL-E и смотрел предыдущие текстовые нейронки для Сказки, то надо и OpenAI Chat посмотреть.

Глубоко не копал, так как концептуально возможности и ограничения были понятны уже из экспериментов с DALL-E.

Приведу пример, как одну из следующих версий этой сетки можно будет использовать для Сказки.

Если вам интересны более детальные демонстрации и выводы, смотрите пост про DALL-E для геймдева.

Используем DALL-E для геймдева

DALL-E: "Vrubel-style painting of an indie game developer working on her game, like The Demon Seated."

Получил доступ к DALL-E и попробовал применить его к чему-нибудь полезному — геймдеву. В конце-концов, к чему ещё прикручивать процедурную генерацию.

Сначала тезисно расскажу об общих впечатлениях, а потом посмотрим для чего в геймдеве можно использовать этот инстрмент прямо сейчас. А для чего пока не получится.

Осторожно, много трафика — DALL-E отдаёт png файлы размером 1-2 мегабайта. Я немного пожал их, но качество старался сохранить на максимуме, поэтому картинки всё-равно тяжёлые.