Симуляция общественного мнения в игре

Демонстрация технического прототипа манипуляции общественным мнением и рассказ как он работает.

Продолжаю участвовать в школе World Builders. За последний месяц набросал технический прототип механик манипуляции общественным мнением.

Вы играете за главного редактора новостного агентства, который отправляет журналистов на задания, а по результатам расследований публикует статьи с фокусом на нужные (игроку) темы.

Всё интересное можно найти в заглавном видео, ниже текстом пройдусь по основным моментам.

Чистим результаты опроса игроков в стратегии

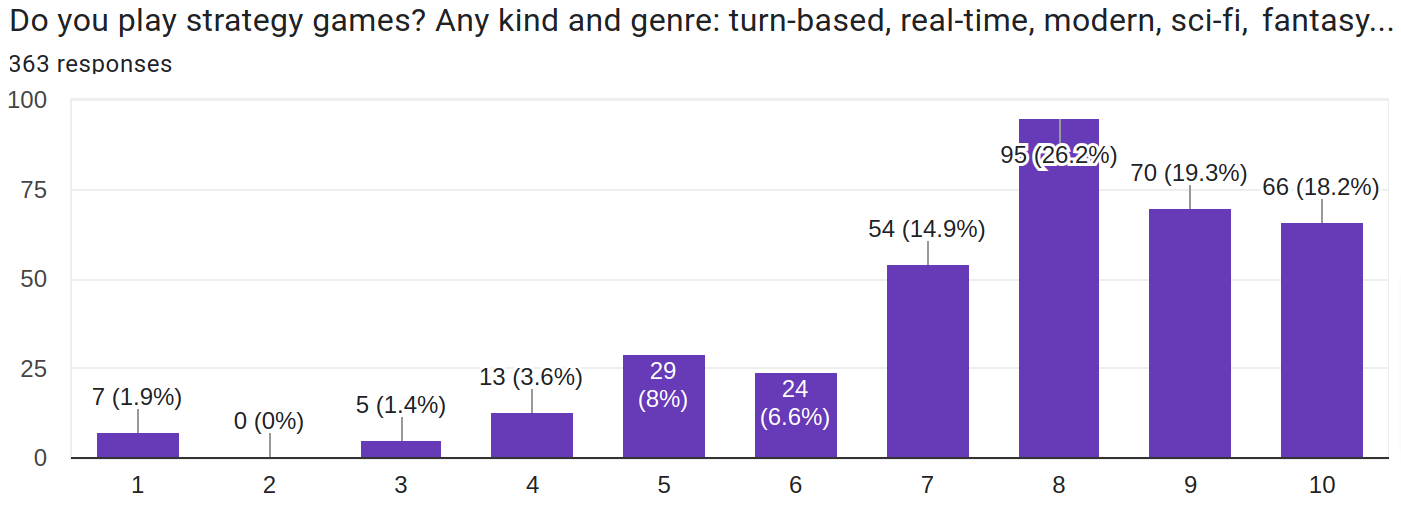

Опрос был нацелен на любителей стратегических игр, удалось попасть достаточно точно.

Недавно просил вас пройти опрос о стратегических играх.

Спасибо всем, кто уделил этому время. Пора делиться результатами.

Было заполнено 363 анкеты. После нормализации и очистки данных осталось 304.

Будет два поста:

- Этот — о методике сбора и обработки данных, их очистке. Будут пошарены очищенные данные.

- Следующий — об анализе результатов.

Игровое сообщество с точки зрения независимого разработчика игр

Изначально статья была опубликована на Хабре в 2014 году, но я решил вернуть её в блог. Изменений не делал, поэтому подача может немного отличаться от традиционной.

Привет, я уже второй год с переменным успехом пилю свою браузерку и хочу поделиться опытом формирования и работы с игровым сообществом, когда на это нет ни ресурсов ни времени. А так же рассказать про пользу, которую оно может принести.

Текст в первую очередь будет полезен как вводная для таких же одиночек как я и небольших команд, начинающих свой проект и не имеющих возможности нанять отдельного специалиста.

Что будет, если открыть код игры

Почти 6 лет как я открыл исходный код Сказки под BSD-3 лицензией. Давно пора рассказать как это отразилось на игре и её разработке.

Русскоязычная GPT-2+ от Сбера vs «Сказка»

Сбер выпусти свой генератор текста, основанный на GPT-2. Я попробовал скормить ему сказочные описания действий героев. Проверял на jupiter note, опубликованной в вебе, так что вы тоже можете с ней поиграть.

Обновлено: говорят, использовали на GPT-3, а GPT-2 с доработками.

Получилось средненько — не на тех текстах всё-таки нейронка обучалась. Вот если бы ей фэнтези скормили… Текст получается осмысленный, но чувствуется явная нехватка контекста.

Самые интересные примеры под катом.